Por: Maximiliano Catalisano

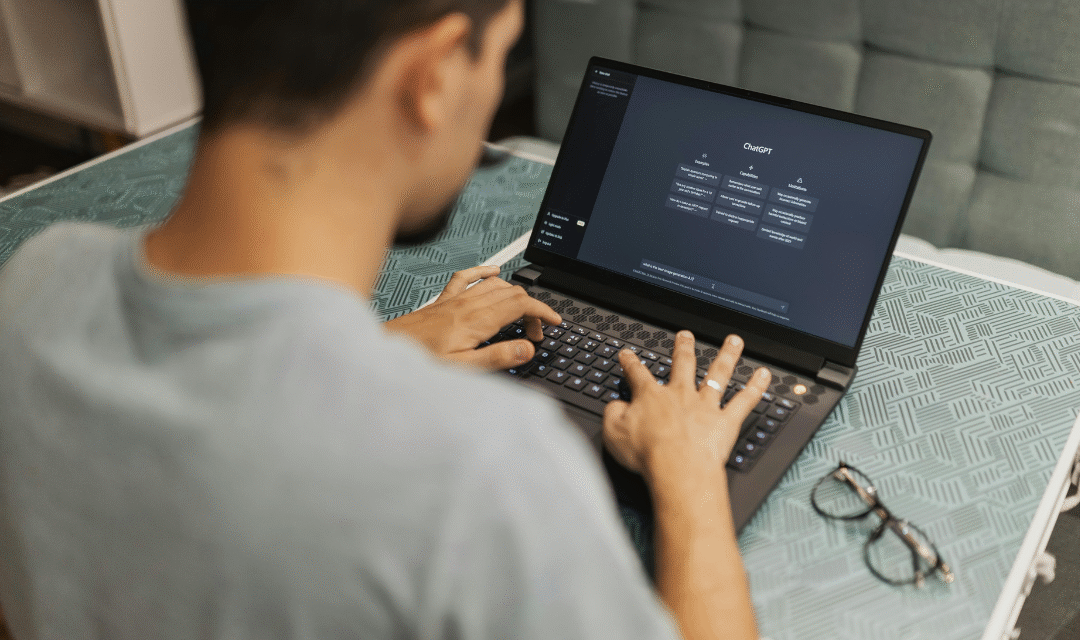

Vivimos en un tiempo donde las máquinas aprenden, crean y hasta parecen pensar. La inteligencia artificial se ha convertido en una presencia constante, desde los algoritmos que recomiendan lo que vemos hasta los sistemas que resuelven tareas complejas en segundos. Sin embargo, entre tanta modernidad tecnológica, surge una pregunta que nos obliga a mirar atrás: ¿Qué puede aprender la inteligencia artificial de los filósofos antiguos? En un mundo que se deslumbra con la velocidad de la información, las voces del pasado todavía guardan lecciones sobre sabiduría, ética y humanidad que podrían guiar el desarrollo de esta nueva era digital.

La inteligencia artificial busca imitar la mente humana, pero ¿De qué mente hablamos? Los filósofos antiguos no tenían máquinas, pero reflexionaron profundamente sobre cómo pensamos, decidimos y actuamos. Sócrates enseñaba a preguntar antes de afirmar, Aristóteles organizaba el conocimiento con lógica y sentido, Platón imaginaba mundos donde la verdad se alcanzaba más allá de las apariencias. Cada uno, a su modo, intentó descifrar la estructura del pensamiento humano mucho antes de que existieran los procesadores. Por eso, quizás el desafío de la inteligencia artificial no sea solo aprender más rápido, sino aprender mejor.

En la base de la filosofía antigua hay una búsqueda de equilibrio entre razón, emoción y virtud. Los algoritmos, en cambio, operan bajo datos y patrones, sin conciencia del bien o del mal. Aristóteles habría advertido que el conocimiento sin virtud puede volverse peligroso, y esa reflexión resuena con fuerza hoy. Las máquinas pueden procesar información, pero carecen de sabiduría. Y la sabiduría, según los antiguos, es mucho más que saber cosas: es comprender el sentido y las consecuencias de los actos.

La inteligencia artificial actual puede analizar millones de textos filosóficos en segundos, pero no puede sentir asombro ni dudar, dos rasgos que Sócrates consideraba esenciales para el conocimiento. Esa ausencia de asombro es quizás su mayor limitación: la incapacidad de maravillarse ante lo que no comprende. La educación filosófica de los antiguos partía de la pregunta, no de la respuesta. La IA, en cambio, se construye sobre certezas y algoritmos que buscan predecir. En ese contraste, los humanos seguimos teniendo una ventaja irremplazable: la capacidad de buscar sentido más allá de los datos.

Si los filósofos antiguos pudieran dialogar con la inteligencia artificial, probablemente le recordarían que conocer no siempre es dominar. Heráclito diría que todo cambia, y que aferrarse a la información es inútil si no se entiende el flujo de la vida. Epicuro recordaría que el conocimiento debe servir para alcanzar serenidad, no ansiedad. Y Séneca, con su mirada estoica, enseñaría a los programadores que el verdadero poder está en gobernarse a sí mismo, no en controlar a los demás. Estas ideas no son obsoletas: son brújulas morales para una tecnología que corre el riesgo de avanzar sin dirección.

El desarrollo tecnológico sin reflexión ética puede llevar a un vacío peligroso. Los filósofos antiguos sabían que el saber debía estar guiado por la virtud y la justicia. Platón advertía que el conocimiento sin moral podía volverse tiránico, y esa advertencia resuena en cada debate sobre el uso de la inteligencia artificial. Cuando los algoritmos deciden qué vemos, qué compramos o incluso cómo pensamos, la filosofía vuelve a ser necesaria. Necesitamos recordar que detrás de cada decisión automática hay una responsabilidad humana.

Aprender de los filósofos antiguos no significa detener el progreso, sino humanizarlo. Ellos enseñaron que el conocimiento sin sabiduría es incompleto. La inteligencia artificial puede calcular, pero no puede amar; puede analizar, pero no puede cuidar; puede aprender, pero no puede comprender el sentido profundo de la existencia. Es aquí donde la educación humana conserva su lugar insustituible: enseñar a pensar, a discernir, a reflexionar sobre lo que se hace con el poder del conocimiento.

Quizás el desafío no sea que las máquinas piensen como humanos, sino que los humanos recuerden cómo pensar con profundidad. En una era donde la inmediatez domina, la filosofía antigua nos invita a la lentitud del razonamiento, al diálogo, a la introspección. Sócrates no tenía redes sociales, pero su método del diálogo sigue siendo más revolucionario que cualquier algoritmo: escuchar, preguntar, repensar. Esa actitud es la que puede guiar el desarrollo de tecnologías más conscientes y responsables.

Cuando se habla de inteligencia artificial, se habla de aprendizaje automático, pero los filósofos antiguos entendían que aprender no es acumular datos, sino transformarse. La educación del alma —como diría Platón— no puede ser reemplazada por ninguna red neuronal. Si los sistemas del futuro desean acercarse a una forma más completa de inteligencia, deberán incorporar algo que no se programa: la ética, la empatía, la contemplación. Solo entonces podremos hablar de una inteligencia verdaderamente humana, incluso dentro de una máquina.

En definitiva, la inteligencia artificial puede aprender de los filósofos antiguos que el conocimiento sin reflexión es ciego, que el poder sin moral es peligroso y que la verdadera sabiduría se encuentra en el equilibrio entre saber y ser. Las máquinas pueden ayudarnos a resolver problemas, pero los humanos seguimos siendo los únicos capaces de preguntarnos por el sentido. Tal vez, después de todo, el mayor desafío no sea enseñar a las máquinas a pensar como nosotros, sino recordar nosotros mismos cómo pensar como los antiguos.